Construyendo un motor de memoria para convertir notas diarias en conocimiento propio

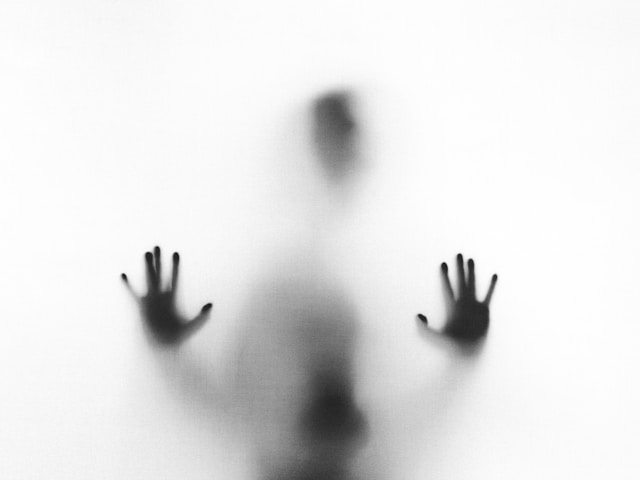

Las apps de journaling prometen ayudarte a reflexionar. La mayoría te da una caja de texto y espera que tú hagas el trabajo cognitivo. Yo estoy construyendo algo diferente